Die 6 besten HeyGen Alternativen im Jahr 2026 (in der Praxis getestet)

KI Videos mit über 240 Avataren in mehr als 160 Sprachen erstellen.

🎬 Was sind die besten Alternativen zu HeyGen?

- Synthesia: Am besten für interaktive Schulungen, Enablement und interne Kommunikation

- Creatify: Am besten für Social Ads im UGC-Stil und Performance-Marketingvideos

- AI Studios: Mit manueller Steuerung der Gesten des Avatars

- Veed: Starke Funktionen zur Zeitleistenbearbeitung und zum Recycling von Inhalten für Social Teams

- Elai: Superschnelles Video-Rendering

- Colossyan: Fokus auf den Schulungsanwendungen

HeyGen zeichnet sich durch ausdrucksstarke, natürlich aussehende Avatare und gute Lippensynchronisation aus. Für kurze Marketing- und Marken-Videos liefert es schnell attraktive Ergebnisse.

Bei längeren Projekten können jedoch Zuverlässigkeitsprobleme auftreten, wie Rendering-Blockaden und Verschiebungen der Zeitleiste. Benutzer halten die Preisgestaltung teilweise für unübersichtlich und den Support für wenig hilfreich.

Daher kann es sich lohnen, Alternativen zu erkunden.

Hier die besten HeyGen Alternativen und die Anwendungsfälle, für die sie am besten geeignet sind.

So habe ich diese HeyGen Alternativen getestet

Ich habe diese KI Avatar Plattformen mit dem gleichen Skript in zwei Sprachen getestet, um einen konsistenten Vergleich zu gewährleisten.

Jede Plattform wurde mit HeyGen anhand identischer Eingaben und ähnlicher Arbeitsabläufe verglichen. Im Durchschnitt testete ich jedes Tool etwa 1 Stunde auf Avatar-Realismus, Lippensynchronisationsgenauigkeit, Lokalisierungsqualität, Arbeitsablauf-Erfahrung und Gesamtstabilität.

Wie schneiden diese Alternativen gegenüber HeyGen ab?

1. Synthesia

URL: https://www.synthesia.io/

Was ist Synthesia?

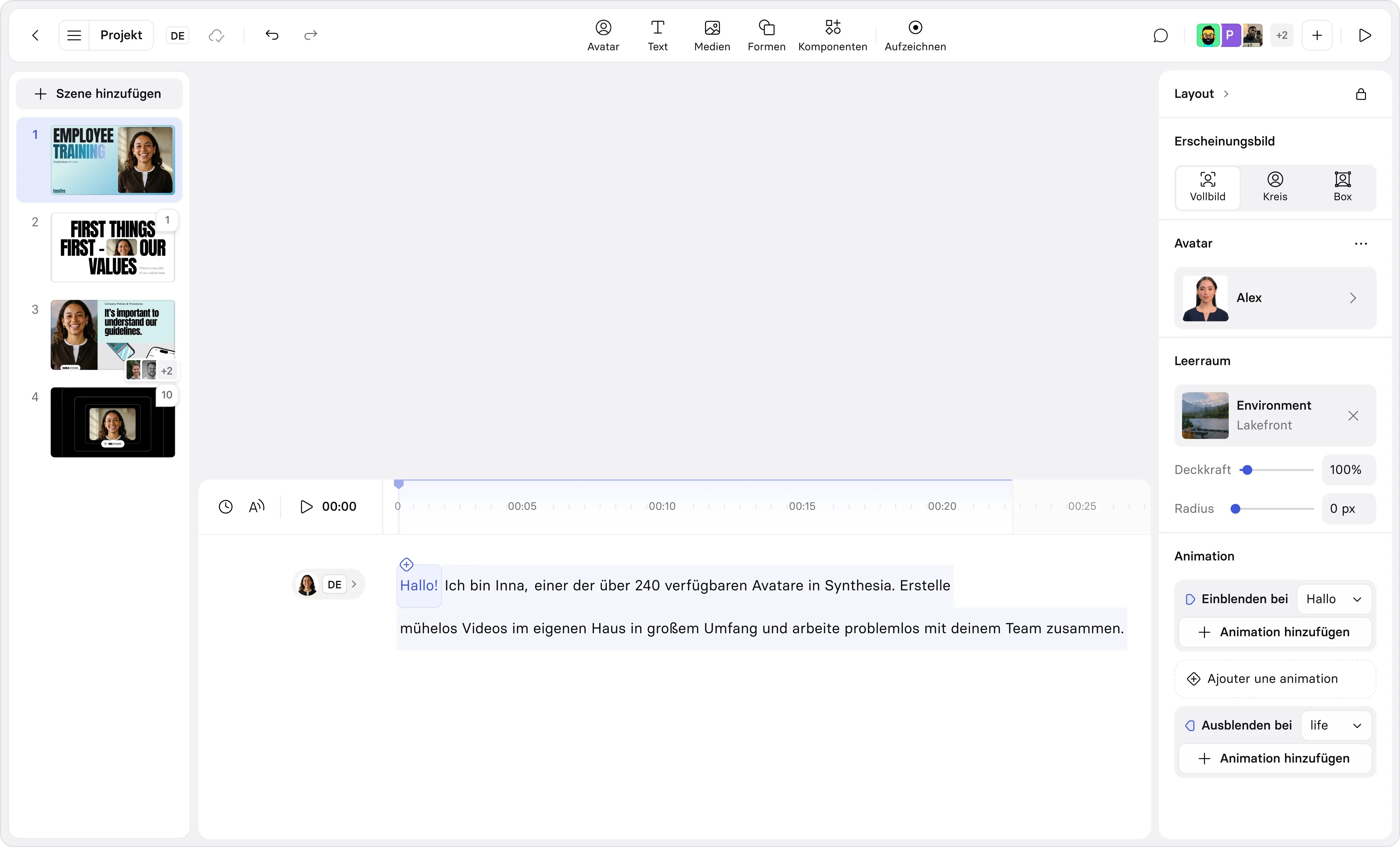

Synthesia positioniert sich als KI Videoplattform für Unternehmen, und das spiegelt sich im Nutzererlebnis wider. Die Benutzeroberfläche ist strukturiert und präsentationsorientiert. Der Workflow ist klar für Unternehmensschulungen, Kommunikation im Personalwesen, Sales Enablement und mehrsprachige interne Nachrichten konzipiert.

Das Vorgehen bei der Erstellung ist einfach: Skript, Avatar auswählen, Stimme auswählen, Layout anpassen, Video generieren und bei Bedarf übersetzen. Alles macht einen organisierten und kontrollierten Eindruck. Es geht weniger um kreative Experimente, sondern um die Massenproduktion von attraktiven, zuverlässigen geschäftlichen Inhalten.

Eine Einschränkung, auf die ich gestoßen bin: Unterstützt werden nur Chrome und Edge, nicht Safari.

Wie realistisch sind die Avatare von Synthesia?

In Englisch ist der Realismus außergewöhnlich gut.

Die Mimik ist subtil und kontrolliert. Mikroausdrücke wirken natürlich. Der Avatar hält Blickkontakt, neigt leicht den Kopf und macht kontrollierte Handgesten. Während meines ~100-Wort-Tests im Präsentationsstil fühlte sich das Ergebnis sehr menschenähnlich an.

Aufmerksamen Betrachtern fallen vielleicht kleine Gesichtsartefakte auf, aber insgesamt ist der Realismus der englischen Version einer der stärksten, die ich in dieser Kategorie getestet habe.

Es gibt über 240 lizenzfreie Avatare aus verschiedenen Berufen; persönliche Avatare werden ebenfalls unterstützt, auch Voice Cloning und benutzerdefinierte Handbewegungen.

Wie ausdrucksstark und natürlich wirken die Avatare?

Die Avatare von Synthesia sind ausdrucksstark, aber auf eine zurückhaltende, professionelle Art und Weise.

Gesten sind kontrolliert und professionellen Präsentationen angemessen. Die Kopfbewegung ist subtil statt dynamisch. Das funktioniert gut für strukturierte Erklärungs- oder Schulungsinhalte, weniger für hochanimierte Präsentationen in den Social Media.

Die Rahmenoptionen (stehen, sitzen, gehen) erweitern die Flexibilität, der Gesamteindruck bleibt aber anspruchsvoll und präsentationsfokussiert.

Kurz gesagt, die Bewegung wirkt gezielt und professionell, nicht energiegeladen oder dramatisch.

Wie gut sind die Stimmen und die Lippensynchronisation?

Die Lippensynchronisation in Englisch war in meinen Tests sehr präzise. Lange Sätze blieben stabil, die Artikulation driftete nicht weg. Die Mimik war natürlich auf die Sprache abgestimmt.

Die Sprachausgabe in Englisch klang natürlich, mit gutem Tempo und guter Intonation. Die neueren Sprachfunktionen sind ebenfalls nützlich, beispielsweise die absatzweise erneute Sprachgeneration und das einstellbare Sprechtempo.

In Spanisch blieb die Lippensynchronisation genau, allerdings war die Natürlichkeit der Stimme im Vergleich zu Englisch etwas schlechter, aber insgesamt immer noch stark.

Für alle Sprachen ist die Leistung hoch, wobei Englisch eindeutig am besten ist.

Wie gut sind Lokalisierung und mehrsprachige Unterstützung?

Das ist einer der stärksten Bereiche von Synthesia.

Die Plattform unterstützt die Generierung in über 160 Sprachen und die Übersetzung in 139 Sprachen, wobei die ursprüngliche Identität der Stimme erhalten bleibt. Voice Cloning ist in 29 Sprachen verfügbar.

Am meisten fiel mir auf, wie nahtlos der Übersetzungsablauf ist. Du kannst direkt im Editor übersetzen und musst nicht manuell Versionen exportieren und neu erstellen.

In meinem spanischen Test wurde das Sprechtempo beibehalten und die Lippensynchronisation blieb genau. Die Rendering-Zeit war deutlich länger als bei der englischen Version, aber der Arbeitsablauf selbst war reibungslos und ganzheitlich.

Für mehrsprachige Unternehmenskommunikation ist das ein großer Vorteil.

Für welche Anwendungsfälle ist Synthesia besonders gut geeignet?

Synthesia eignet sich besonders gut für:

- Schulungen für Unternehmen

- Personalwesen und interne Kommunikation

- Personalentwicklung

- Sales Enablement

- Strukturiertes B2B-Marketing

- Mehrsprachige Unternehmensinhalte

Das folienbasierte Layout-System eignet sich ideal für erklärende Präsentationen. Tools zur Zusammenarbeit, Workspace-Management, SSO-geschützte Videoseiten und Kontrollfunktionen für das Markenkit verbessern die Unternehmenspositionierung.

Es ist für große Unternehmen konzipiert und kann wiederholbare, strukturierte Inhalte produzieren.

Bei welchen Anwendungsfällen hat Synthesia Schwierigkeiten?

In meinen Tests erwies sich Synthesia als weniger geeignet für:

- Automatisierungsintensive Arbeitsabläufe

- Schnelle Iteration sozialer Inhalte

- Ereignisgesteuerte Video-Personalisierung

- Dynamisches, energisches Marketing in Kurzformaten

Es gibt derzeit weder ein Automatisierungssystem noch ereignisgesteuerte Arbeitsabläufe. Das Rendering dauert auch länger als bei einigen Mitbewerbern, was wichtig sein kann, wenn Geschwindigkeit Priorität hat.

Das Tool ist für Struktur und Zuverlässigkeit optimiert und nicht für schnelle Experimente.

Welche Stärken hat Synthesia?

- Extrem natürliche, realistische englische Avatare

- Hochpräzise Lippensynchronisation

- Problemlose Übersetzung im Editor

- Starke Unternehmenskontrollen für die Veröffentlichung

- KI Playground zur erweiterten Medienproduktion

- Erneute Sprachgeneration und Temposteuerung

- Zuverlässiger strukturierter Editor

Die Kombination aus Realismus und Arbeitsabläufen für Unternehmen ist es, die Synthesia von anderen unterscheidet.

Welche Schwächen hat Synthesia?

- Keine Safari-Unterstützung

- Längere Rendering-Zeiten

- Weniger geeignet für automatisch gesteuerte Marketing-Arbeitsabläufe

Das sind keine kritischen Mängel, aber sie entscheiden darüber, für wen die Plattform optimal geeignet ist.

Wie schneidet Synthesia im Vergleich zu HeyGen ab?

In meinen Tests haben Synthesia und HeyGen professionelle Ergebnisse geliefert, aber mit leicht unterschiedlichen Prioritäten.

Die Avatare von HeyGen scheinen besser für Social-Media-Werbung im UGC-Stil geeignet zu sein, Synthesia dagegen macht einen strukturierten und kontrollierten Eindruck und funktioniert wirklich gut für Unternehmenskommunikation, Schulungen und mehrsprachige Arbeitsabläufe.

Wie lautet das Urteil über Synthesia?

Nach dem praktischen Test ist Synthesia für mich eine der stärksten Plattformen für die strukturierte, mehrsprachige Videoproduktion von Unternehmen.

Wenn deine Prioritäten Realismus für Unternehmen, kontrollierte Präsentationsabläufe und nahtlose Übersetzungen im Editor sind, funktioniert Synthesia extrem gut.

Wenn du mehr Videos mit ausdrucksstarken UGC-Avataren benötigst, eignen sich andere Plattformen möglicherweise besser.

2. Creatify

URL: https://creatify.ai/

Was ist Creatify?

Als ich Creatify testete, wurde mir klar, dass dies kein gewöhnlicher Avatar-Generator ist. Das Tool hat sich zu einer vollständigen KI Werbeplattform entwickelt.

Die Positionierung macht das deutlich. Alles im Produkt ist auf Performance-Marketing ausgerichtet. Sobald du das Dashboard aufrufst, liegt der Fokus auf Geschwindigkeit, Variationstests und messbaren Ergebnissen.

Das ist kein folienbasierter Präsentationsgenerator und kein Studio für Unternehmensschulungen. Das Tool ist für Werbetreibende, E-Commerce-Marken und Wachstumsteams konzipiert, die schnell kreative Anzeigen in großer Zahl generieren und aktivieren müssen.

Der Ablauf spiegelt dieses Konzept wider. Du kannst aus einer URL, einem Skript oder einer Produkteingabe mehrere Anzeigenvariationen erstellen, die Leistung analysieren und Kampagnen direkt starten. Das Tool erscheint eher wie eine Performance-Engine und nicht wie ein traditioneller Videogenerator.

Wie realistisch sind die Avatare von Creatify?

Der Realismus der Avatare bei Creatify hat mich wirklich beeindruckt.

In meinem Skript-zu-Avatar-Test (ca. 100 Wörter) war die Ausgabe fast nicht von echtem UGC-Inhalt zu unterscheiden. Die Gesichtsdarstellung war scharf und stabil. Die Augenbewegungen sahen natürlich aus. Mikroausdrücke waren vorhanden. Nichts fühlte sich steif oder künstlich an.

Mit Aurora, dem proprietären Bild-zu-Video-Modell, generierte ich einen sprechenden Avatar aus einem Foto- und Audioinput. Der emotionale Realismus war so stark, dass ich genau hinschauen musste, um Hinweise auf die künstliche Herkunft zu entdecken.

Unter den Avatar-Systemen im UGC-Stil ist dies eines der realistischsten, die ich bisher getestet habe.

Wie ausdrucksstark und natürlich wirken die Avatare?

Creatify unterstützt Avatare im Vollprofil, was einen merklichen Unterschied ergibt.

Gesten sind kontextsensibel und im Einklang mit dem Sprachrhythmus. Die Kopfbewegungen erscheinen organisch und nicht roboterhaft. Emotionale Verschiebungen im Skript zeigen sich in der Ausgabe.

In meinen Tests sprach der Avatar nicht einfach nur Text. Er erweckte ihn zum Leben. Die Körpersprache verstärkte die Botschaft so, dass sie für die Interaktion mit Anzeigen optimiert ist, insbesondere auf sozialen Plattformen.

Die Bewegungen wirken nicht übertrieben oder theatralisch. Es sieht so aus, als würde jemand ein echtes, überzeugendes UGC-Video aufnehmen.

Wie gut sind die Stimmen und die Lippensynchronisation?

Die Qualität der Stimmen hängt von der gewählten Voice Engine ab. Die standardmäßige KI für Text-zu-Sprache ist solide, und die Integration von ElevenLabs ermöglicht ein höheres Maß an Realismus, falls erforderlich.

Die Genauigkeit der Lippensynchronisation war in meinen Tests sehr gut. Die Artikulation war stabil. Der Sprachrhythmus stimmte mit der Gestik und Mimik überein. Ich habe weder ein Driften noch Abweichungen beim Timing bemerkt.

Selbst während meines Lokalisierungstests für Spanisch blieb die Lippensynchronisation präzise und emotional konsistent. Das ist oft der Punkt, an dem schwächere Avatar-Systeme versagen, aber Creatify hielt sich gut.

Wie gut sind Lokalisierung und mehrsprachige Unterstützung?

Creatify unterstützt mehrsprachige Ausgaben, die Übersetzung muss jedoch manuell erfolgen. Es gibt keine integrierte automatische Skriptübersetzung.

Bei meinem Test mit Spanisch kam das System problemlos mit der neuen Sprache zurecht, sobald das Skript übersetzt war. Die Lippensynchronisation blieb genau. Die Abstimmung der Gestik blieb konsistent. Die emotionale Tonalität wurde gut übertragen.

Die technische Ausführung ist solide. Die größte Einschränkung sind Verzögerungen im Arbeitsablauf, da fremdsprachige Versionen manuell übersetzt werden müssen.

Für welche Anwendungsfälle ist Creatify besonders gut geeignet?

Creatify ist eindeutig optimiert für:

- E-Commerce-Werbung

- Leistungs-Marketingkampagnen

- TikTok- und Meta-Anzeigen

- Kreative Tests in großem Umfang

- Kurzvideos im UGC-Stil

Im Batch-Modus kannst du schnell mehrere Variationen generieren. Durch integrierte A/B-Tests und Analysen kannst du ROAS, CTR und Ausgaben für jeden Kreativen verfolgen. Du kannst sogar direkt von der Plattform aus Anzeigen live schalten.

Wenn du in den sozialen Medien Bezahlwerbung im großen Umfang betreibst, macht das Ökosystem Sinn.

Bei welchen Anwendungsfällen hat Creatify Schwierigkeiten?

Nach meinen Tests erscheint Creatify weniger geeignet für:

- Strukturierte Unternehmensschulungen

- Langformate für Bildungsinhalte

- Videos im Präsentationsstil

- Automatische Produktion in mehreren Sprachen

Das Tool ist stark auf Arbeitsabläufe für Werbung optimiert. Wenn du strukturierte Unternehmenskommunikation oder Schulungsinhalte mit Präsentationsfolien produzieren musst, ist das wahrscheinlich nicht die passendste Lösung.

Welche Stärken hat Creatify?

- Extrem realistische Avatare im UGC-Stil

- Proprietäre Avatar-Engine Aurora

- Avatare im Vollprofil

- Emotionale Lippensynchronisation

- Batch-Abläufe für Anzeigenvariationen

- Integrierte Analysen und A/B-Tests

- Direkte Integration zum Start der Kampagnen

- KI Musikgenerierung

- Hohe Stabilität während der Tests

Unübertroffen ist die Kombination aus realistischen Avataren und Marketinginfrastruktur.

Was sind die Schwachpunkte von Creatify?

- Keine integrierte automatische Übersetzung

- Das kreditbasierte Preismodell ist unübersichtlich.

- Kostenloser Plan auf 10 Credits begrenzt

- Nicht für Unternehmensschulungen optimiert

- Stark auf vertikale Kurzanzeigen fokussiert

Keiner dieser Punkte ist ein Ausschlusskriterium, wenn du zur Zielgruppe gehörst, aber sie sollten erwähnt werden.

Wie schneidet Creatify im Vergleich mit HeyGen ab?

Als ich Creatify und HeyGen im Test verglich, schnitt HeyGen bei Ausdrucksstärke und Avatar-Realismus besser ab. Die Stärke von Creatify sind seine marketingorientierten Arbeitsabläufe und Kampagnenanalysen, dagegen wirken die Avatarbewegungen, Gestenqualität und das Sprachökosystem von HeyGen ausdrucksvoller und natürlicher. Wenn du nur glaubwürdige Moderatoren mit minimalem Setup generieren willst, ist HeyGen zu empfehlen. Wenn du vor allem Anzeigenvariationen erstellen willst, die mit der Leistungsüberwachung verknüpft sind, eignet sich Creatify besser.

Wie lautet das Urteil über Creatify?

Nach dem praktischen Test halte ich Creatify für eine der stärksten Plattformen, die derzeit für KI-gesteuerte Werbung verfügbar sind.

Wenn du vor allem Wert auf eine skalierbare Anzeigenproduktion, emotional ausdrucksstarke UGC-Avatare und integrierte Leistungsverfolgung legst, ist Creatify anderen Avatar-Plattformen in dieser Nische überlegen.

Wenn du strukturierte Unternehmensschulungen oder Langformat-Schulungsinhalte erstellst, brauchst du möglicherweise etwas, was sich besser für Präsentationen eignet.

3. Vimeo-Videoplayer – AI Studios KI Avatar

URL: https://www.aistudios.com/

Was ist AI Studios?

Ich habe AI Studios im kostenlosen Plan getestet. Es scheint mehr ein virtuelles Broadcast-Studio zu sein, nicht nur ein einfacher Avatar-Editor.

Es wird als All-in-One-KI-Studio positioniert, und diese Beschreibung trifft zu. Neben Avataren integriert es KI Synchronisation in über 150 Sprachen, erweiterte generative Videomodelle, KI Bilderzeugung, interaktive Avatare und sogar Tools zur Erkennung von Deepfakes. Es funktioniert mehr wie eine zentrale KI Produktionsumgebung, nicht wie ein spezialisiertes Avatar-Tool.

Der Arbeitsablauf ist strukturiert: Skript, Avatar auswählen, Stimme und Sprache wählen, ggf. Gesten anpassen, generieren, exportieren. Es gibt auch alternative Abläufe wie Thema-zu-Video, URL-zu-Video und Dokumente-zu-Video.

Insgesamt erscheint das Tool durchdacht und für Unternehmen konzipiert.

Wie realistisch sind die Avatare von AI Studios?

Die Avatare sind sehr realistisch, allerdings nicht perfekt.

In meinem englischen Skript-zu-Avatar-Test (~100 Wörter) sahen die Körperbewegungen natürlich aus und die Körperhaltung kontrolliert. Mikroausdrücke waren präsent, die gesamte Präsentation wirkte ausgefeilt.

Beim genauen Hinsehen bemerkte ich geringfügige Artefakte in den Augen und in bestimmten Momenten eine leichte Verzögerung der Lippensynchronisation. Diese störten zwar nicht, waren aber bei genauer Betrachtung erkennbar.

Im Vergleich zu dynamischeren Avatar-Systemen für Social Media erscheint AI Studios eher „für TV optimiert“ statt natürlich. Es eignet sich gut für strukturierte, professionelle Umgebungen.

Wie ausdrucksstark und natürlich wirken die Avatare?

In AI Studios hast du mehr manuelle Kontrolle über Gesten als bei den meisten anderen Plattformen, die ich getestet habe.

Es gibt ein Gestensteuerungspanel, das eine explizite Verhaltensprogrammierung ermöglicht. Du kannst Szenen mit mehreren Avataren erstellen und Haltung und Bewegung technisch steuern.

Das erlaubt Präzision. Die Bewegungen wirken strukturiert und kontrolliert, nicht spontan. Das funktioniert gut für Unternehmenspräsentationen und Inhalte im Nachrichtenstil.

Der Nachteil ist, dass die emotionale Fluidität leicht eingeschränkt ist. Das System priorisiert Stabilität im Nachrichtenstil, nicht dynamische Persönlichkeit.

Wie gut sind die Stimmen und die Lippensynchronisation?

Die Sprachqualität hängt stark von der verwendeten Engine ab.

Das Timing wurde in Spanisch beibehalten, aber die Gesichtsanimation wirkte etwas steifer als in der englischen Version. Die Stimmen von ElevenLabs sind sehr realistisch. Im kostenlosen Plan klang die Standardstimme flacher und künstlicher.

Die Lippensynchronisation in Englisch war insgesamt genau, auch wenn ich bei genauer Betrachtung leichte Mikroverzögerungen bemerkte. Das Timing wurde in Spanisch beibehalten, aber die Gesichtsanimation wirkte etwas steifer als in der englischen Version.

Technisch gesehen funktioniert es gut. Emotional wirkt es etwas kontrollierter und weniger flüssig als die ausdrucksstärksten Mitbewerber.

Wie gut sind Lokalisierung und mehrsprachige Unterstützung?

AI Studios unterstützt KI Synchronisation in über 150 Sprachen, was erheblich ist.

In meinem Spanisch-Lokalisierungstest wurde das Tempo beibehalten, die Lippensynchronisation blieb stabil. Die Unterstützung für Akzente war genau. Das Rendering dauerte länger als in der englischen Version, blieb jedoch im angemessenen Rahmen.

Die Emotionen in der spanischen Version wirkten etwas flacher, wahrscheinlich durch die Einschränkungen der Voice-Engine im kostenlosen Plan.

Insgesamt ist die mehrsprachige Unterstützung technisch gut, insbesondere für Unternehmensanwendungen, die eine umfangreiche Sprachabdeckung erfordern.

Bei welchen Anwendungsfällen schneidet AI Studios besonders gut ab?

Meinen Tests zufolge eignet sich AI Studios besonders gut für:

- Präsentationen für Unternehmen

- Produkt-Demos

- Unternehmensschulungen

- Inhaltsstile wie bei Nachrichtensendungen

- Strukturierte Videoproduktion in längeren Formaten

Durch die große Avatar-Bibliothek (über 2000 Avatare), Szenen mit mehreren Avataren, die manuelle Gestensteuerung und integrierte KI Videomodelle ist die Plattform gut geeignet für Teams, die Infrastruktur und Kontrolle benötigen.

Es scheint für Unternehmen konzipiert zu sein, die eine vollständige KI Produktionsumgebung "unter einem Dach" wünschen.

Mit welchen Anwendungsfällen hat AI Studios Schwierigkeiten?

AI Studios ist weniger geeignet für:

- Kreative für schnelllebige Social Media Inhalte

- Hoch emotionale, persönlichkeitsgesteuerte Inhalte

- Schnelle Iterationsabläufe

- Projekte mit filmischem Storytelling

Die Benutzeroberfläche ist komplexer als bei einfacheren Plattformen. Es gibt viele Steuerelemente und Optionen, die zwar Leistung erhöhen, aber auch die Zeit zur Navigation.

Wenn es dir vor allem auf Einfachheit und Geschwindigkeit ankommt, könnte das Tool unnötig komplex sein.

Welche Stärken hat AI Studios?

- Bibliothek mit über 2000 Avataren

- Szenen mit mehreren Avataren

- Manuelle Gesten-Skripterstellung

- Zudem ist die Avatar-Bibliothek kleiner als bei einigen Mitbewerbern.

- Deepfake-Erkennungssystem

- Umfassende mehrsprachige Synchronisation (über 150 Sprachen)

- Hohe Anpassungstiefe

- Für Unternehmen geeignetes Ökosystem

Der Umfang der Funktionen und die Infrastruktur sind die größten Vorteile.

Welche Schwächen hat AI Studios?

- Leichte Gesichtsartefakte bei Nahaufnahmen

- Leichte Mikroverzögerung der Lippensynchronisation

- Rendering für Spanisch langsamer als für Englisch

- Stimmqualität in der kostenlosen Version schlechter

- Benutzeroberfläche komplexer als bei einfacheren Plattformen

All dies sind keine kritischen Mängel, aber sie prägen das Gesamterlebnis.

Wie schneidet AI Studios im Vergleich zu HeyGen ab?

Verglichen mit HeyGen erscheint AI Studios mehr wie eine Produktionsumgebung mit tiefen Steuerungen und manuellen Gestenoptionen. Die Bewegungen und Ausdrucksformen von HeyGen erscheinen standardmäßig natürlicher und flüssiger, AI Studios bietet dagegen eine höhere manuelle Präzision und ein umfassenderes Ökosystem von Tools. Wenn du schnelle, ausdrucksstarke Ergebnisse brauchst, kannst du mit HeyGen intuitiver arbeiten. Wenn du manuelle Kontrolle und eine strukturierte, tiefe Produktion brauchst, hat AI Studios einige Vorteile.

Was ist das Urteil über AI Studios?

Nach dem Test halte ich AI Studios für eine technisch starke Plattform mit umfangreicher Infrastruktur, bei der Kontrolle und ein tiefes Ökosystem Vorrang haben.

Es überzeugt durch Realismus, Unterstützung mehrerer Sprachen und strukturierte Szenengestaltung. Die manuelle Gestensteuerung und die große Avatar-Bibliothek ermöglichen Flexibilität in Unternehmensproduktionsumgebungen.

Wenn du professionelle Videos wie beim Fernsehen, Szenen mit mehreren Avataren und integrierte KI-Tools innerhalb eines Ökosystems brauchst, macht AI Studios Sinn.

Wenn dir emotionale Fluidität, Einfachheit oder schnelle Marketingiteration wichtig sind, dürftest du mit anderen Plattformen intuitiver arbeiten.

4. Veed

URL: https://www.veed.io/

Was ist VEED?

Ich habe VEED im kostenlosen Plan getestet. Als Erstes fiel mir auf, dass dies keine Avatar-First-Plattform ist.

VEED präsentiert sich als vollständiger Online-Videoeditor, in den KI in jedem Teil integriert ist. Die Avatar-Funktion ist nur ein Teil eines viel größeren Ökosystems, das Zeitleistenbearbeitung, automatische Untertitel, Hintergrundentfernung, Augenkontaktkorrektur, Clip-Tools und einen großen Playground für KI-Modelle umfasst.

Dieser Unterschied zeigt sich im Arbeitsablauf. Statt mit einfachen Skript-zu-Avatar-Abläufen arbeitest du auf einer Zeitleiste. Du fügst den Avatar hinzu, legst eine Ebene mit B-Roll-Material darüber, passt Untertitel an, fügst Effekte ein und exportierst das Ganze. Das Tool ist eher ein Bearbeitungsprogramm im Browser mit integrierter KI Generierung.

Wenn du ein reines Avatar-Studio erwartest, kann die Benutzeroberfläche zu komplex sein. Wenn du dagegen eine vollständige Produktionskontrolle suchst, macht es sehr viel mehr Sinn.

Wie realistisch sind die Avatare von VEED?

Die Avatare sehen sauber und professionell aus, aber die emotionale Tiefe ist im Vergleich zu den ausdrucksvollsten Plattformen begrenzt.

In meinem kurzen Erklärvideo-Test (~100 Wörter) war der Realismus insgesamt gut. Die Gesichtsanimation sah natürlich und visuell überzeugend aus. Die Lippensynchronisation war genau und stabil. Mikrobewegungen wie Blinzeln und subtile Kopfbewegungen verleihen Glaubwürdigkeit.

Die Gestenvariation ist jedoch begrenzt. Es gibt keine detaillierten Posensteuerungen oder emotionalen Voreinstellungen. Zudem ist die Avatar-Bibliothek kleiner als bei einigen Mitbewerbern.

Der Gesamteindruck ist professionell und im Studio-Stil, jedoch nicht sehr ausdrucksstark.

Wie ausdrucksstark und natürlich wirken die Avatare?

Bewegungen wirken ausgewogen und professionell.

Kopfbewegungen sind subtil und stabil. Die Körpersprache wirkt konsistent. Die physische Präsenz des Avatars ist überzeugend, allerdings ohne allzuviele starke emotionale Nuancen.

Gesten sind vorhanden, aber nicht im Detail anpassbar. Du hast keine granularen Kontrollmöglichkeiten über das Bewegungsverhalten, es gibt nicht das gleiche Maß an expressiver Animationstiefe wie bei den stärker auf Avatare fokussierten Plattformen.

Für einfache Erklärvideos funktioniert es gut. Für emotional dynamische Darstellungen erscheint es eingeschränkt.

Wie gut sind die Stimmen und die Lippensynchronisation?

Die Leistung der Lippensynchronisation in meinen Tests war genau und stabil.

Die zeitliche Abstimmung der Gesichtszüge stimmte gut mit der Sprache überein, es gab keine offensichtlichen Desynchronisationsprobleme. Die Sprachqualität im kostenlosen Plan war sauber, aber die Tonalität neutral. Die emotionale Bandbreite wirkte im Vergleich zu fortschrittlicheren Voice-Ökosystemen eingeschränkt.

VEED unterstützt über 120 Sprachen, Synchronisation ist in den kostenpflichtigen Plänen verfügbar. In den vorherigen Tests war die spanische Ausgabe grammatikalisch genau mit präziser Lippensynchronisation, aber die Intonation blieb neutral und es fehlte an Akzentvariation.

Insgesamt ist es technisch solide, jedoch emotional eingeschränkt.

Wie gut sind Lokalisierung und die Unterstützung mehrerer Sprachen?

VEED unterstützt über 120 Sprachen und bietet in den kostenpflichtigen Plänen KI Synchronisation an.

Im kostenlosen Plan konnte ich die vollständige Synchronisation nicht testen. In früheren Tests war die Grammatik genau und die Lippensynchronisation in Spanisch stabil, aber die Akzentkontrolle begrenzt und die Tonalität emotional neutral.

Das Übersetzungssystem funktioniert, ist jedoch nicht die zentrale Stärke der Plattform. Schwerpunkt sind die Bearbeitungs- und Produktionsflexibilität.

Bei welchen Anwendungsfällen schneidet VEED besonders gut ab?

Meinen Tests zufolge eignet sich VEED besonders gut für:

- Social Media Marketingteams

- UGC-Ersteller

- Wiederverwertung von Inhalten in kurzer Form

- Schulungs-Erklärvideos mit hohem Bearbeitungsbedarf

- Teams, die B-Roll-Ebenen und Untertitelkontrolle benötigen

Der Zeitleisten-Editor ist leistungsstark. Du kannst Ebenen hinzufügen, Szenen anpassen, lizenzfreie oder selbst generierte Medien integrieren und das Tempo feinabstimmen. Der KI Playground umfasst eine Vielzahl von Top-Video- und Bildgenerierungsmodellen, was kreative Flexibilität erweitert.

Schnelles Rendering ist ein weiterer Vorteil. Mein Testvideo wurde in weniger als 20 Sekunden generiert.

Wenn für dich Bearbeitungskontrolle Priorität hat, funktioniert VEED sehr gut.

Bei welchen Anwendungsfällen hat VEED Probleme?

VEED eignet sich weniger für:

- Nutzer, die einen einfachen Skript-zu-Avatar-Ablauf suchen

- Nutzer, die auf besonders ausdrucksstarke digitale Moderatoren Wert legen

- Anfänger, die sich eine Benutzeroberfläche mit minimaler Komplexität wünschen

- Vollständige Synchronisations-Abläufe im kostenlosen Plan

Die Benutzeroberfläche kann zu komplex erscheinen, wenn du nur schnell einen sprechenden Avatar generieren willst.

Das Tool ist leistungsstark, aber nicht für reine Avatar-Produktion optimiert.

Welche Stärken hat VEED?

- Professionelle Bearbeitung auf der Zeitleiste

- Starke Integration von KI Modellen

- Schnelles Rendering

- Funktionen zur Zusammenarbeit

- Ausgezeichnete Schnittfunktionen zum Schneiden in kurzer Form

- Einzigartige Funktion „Hintergrundaudio beibehalten“

- Umfangreiches Ökosystem mit KI Modellen für Bilder und Videos

Der größte Unterscheidungsfaktor ist die Bearbeitungsflexibilität.

Welche Schwächen hat VEED?

- Begrenzte Ausdrucksstärke des Avatars

- Kleinere Avatar-Bibliothek

- Synchronisation nur im kostenpflichtigen Plan

- Begrenzte Gestensteuerung

- Zu komplexe Benutzeroberfläche für Nutzer, die nur einen Avatar generieren wollen

- Instabilität in Safari

Diese Einschränkungen stören vor allem dann, wenn die Realitätsnähe des Avatars für dich oberste Priorität hat.

Wie schneidet VEED im Vergleich zu HeyGen ab?

Die Benutzererfahrung von VEED ist eine ganz andere als bei HeyGen. HeyGen konzentriert sich auf ausdrucksstarke Avatare und natürliche Bewegungen, VEED dagegen ist vor allem ein Zeitleisten-Editor, bei dem die Avatare Teil eines größeren Werkzeugkastens sind. Wenn du vor allem Wert auf starke Bearbeitungsfunktionen, Clips, Untertitelung und Produktionsflexibilität legst, ist VEED die beste Wahl. Aber wenn es nur um realistische Avatare mit natürlichen Bewegungen geht, ist HeyGen weiterhin ausdrucksvoller und überzeugender.

Was ist das Urteil über VEED?

Nach dem Test halte ich VEED für ein für Kreative optimiertes Videostudio, das auch Avatare erstellen kann, nicht für eine Avatar-First-Plattform.

Es zeichnet sich durch Bearbeitungsflexibilität, Integration von KI-Modellen und Abläufe zur Wiederverwertung von Inhalten aus. Durch den Zeitleisten-Editor hast du weit mehr Kontrolle als bei folienorientierten Systemen.

Wenn du vor allem Wert auf lebensechte, emotional ausdrucksstarke digitale Moderatoren und einen einfachen Ablauf legst, sind andere Plattformen möglicherweise stärker.

Wenn du dagegen vollständige Produktionskontrolle, Bearbeitung in verschiedenen Ebenen und ein umfangreiches KI-Ökosystem an einem Ort erwartest, ist VEED eine überzeugende Option.

5. Elai

URL: https://elai.io/

Was ist Elai?

Als ich Elai im kostenlosen Plan testete, gefiel mir sofort das strukturierte und automatisierungsfokussierte Konzept.

Das ist keine Plattform, bei der Kreativität im Vordergrund steht. Sie ist so konzipiert, dass du in großem Umfang Dokumente, URLs und Präsentationen in strukturierte Videos umwandeln kannst. Der Ablauf ist klar für eLearning, Personalwesen und Unternehmensdokumentation optimiert, nicht für visuelle Experimente.

Die Benutzeroberfläche ist minimalistisch und funktional, wirkt jedoch optisch im Vergleich zu moderneren Plattformen etwas veraltet. Selbst die Registrierung ist etwas altmodisch, sie basiert nur auf E-Mail und Passwort, ohne modernere Authentifizierungsfunktionen.

Die Philosophie von Elai beschränkt sich klar auf die Umwandlung von Inhalten, es geht nicht um direkte filmische Kreativität.

Wie realistisch sind die Avatare von Elai?

Elai bietet drei Avatar-Typen: Studio-Avatar, Selfie-Avatar und Szenario-Avatar.

Ich testete die Selfie-Avatar-Option. Der Prozess war schnell und zugänglich. Mein englisches Rendering dauerte 1 Minute 34 Sekunden und war damit eines der schnellsten, die ich gesehen habe.

Die Lippensynchronisation war genau. Mikrobewegungen des Körpers waren vorhanden. Das Gesichtstiming wirkte natürlich.

Allerdings hat der Realismus Grenzen. Die Hände waren in meinem Test nicht sichtbar. Das vermeidet die üblichen Probleme mit der Handdarstellung bei KI, reduziert jedoch auch die Authentizität. Die größte Schwäche war die Haardarstellung. Manchmal sah der Avatar aus, als wäre er ausgeschnitten und auf den Hintergrund geklebt worden. Die Haardarstellung reduzierte deutlich die Illusion von Realismus.

Insgesamt ist der Realismus angemessen, aber nicht filmreif.

Wie ausdrucksstark und natürlich wirken die Avatare?

Die Kopfbewegung fühlte sich natürlich an. Die Mikrobewegungen der Schultern waren solide. Die Lippensynchronisation war technisch korrekt.

Die emotionale Ausrichtung war jedoch schwächer als bei ausdrucksstärkeren Plattformen. Die Lieferung erschien strukturiert und etwas flach. Es gibt immer noch ein subtil „NPC-artiges“ Gefühl in einzelnen Momenten.

Die Bewegung wirkt kontrolliert statt organisch. Das funktioniert für Schulungen oder Informationsübermittlung, ist aber nicht sehr dynamisch oder emotional responsiv.

Wie gut sind die Stimmen und die Lippensynchronisation?

Technisch ist die Lippensynchronisation gut.

Die Mundbewegungen stimmen genau mit der Sprache überein. Die Mikrobewegungen sind flüssig. Im Vorschau-Modus war die Lippensynchronisation manchmal nicht präzise genug, eine richtige Bewertung ist nur nach einem Export möglich.

Die englische Sprachausgabe war klar und neutral, aber etwas flach. In früheren spanischen Tests war die Grammatik korrekt und die Lippensynchronisation stabil, aber der Ton klang roboterhaft und es fehlte emotionale Tiefe.

Im Vergleich zu fortgeschritteneren Voice-Ökosystemen wirkt das Ergebnis weniger strukturiert und weniger ausdrucksstark.

Wie gut sind Lokalisierung und mehrsprachige Unterstützung?

Elai unterstützt über 100 Sprachen, automatische Übersetzungen und Voice Cloning.

Bei meinem Rendering-Versuch in Spanisch im kostenlosen Plan brach der Prozess aufgrund eines Fehlers mit der Credit-Abrechnung ab, obwohl noch 57 Sekunden übrig waren. Das deutet auf kleinere Zuverlässigkeitsprobleme im kostenlosen Plan hin.

Bei früheren Tests war die Übersetzung selbst schnell und grammatikalisch korrekt. Die Lippensynchronisation blieb genau. Der Übersetzungsablauf funktioniert, ist jedoch weniger intuitiv als bei Systemen, bei denen die Übersetzungsoption leichter zu finden ist.

Insgesamt ist die Lokalisierung solide, aber ohne außergewöhnliche emotionale Qualität.

Für welche Anwendungsfälle ist Elai besonders gut geeignet?

Elai eignet sich besonders gut für:

- Dokument-zu-Video-Automatisierung

- URL-zu-Video-Konversion

- PPTX-zu-Video-Abläufe

- Schulungsmodule für Unternehmen

- Interaktive Lerninhalte

- SCORM-fähige Exporte

Es unterstützt interaktive Elemente wie klickbare Links, Schaltflächen, Verzweigungslogik sowie Q&A-Sitzungen. Die Automatisierungspipeline ist effizient: Texteingabe, URL oder PPTX, automatische Erstellung von Szenen durch das System, Ergänzung von Avatar und Stimme, generieren, exportieren.

Die Rendering-Geschwindigkeit ist einer der größten Vorteile.

Bei welchen Anwendungsfällen hat Elai Probleme?

Elai ist weniger geeignet für:

- Marketingkampagnen

- Persönliches Branding

- Emotionales Storytelling

- Filmische Inhalte

- KI-generierte Videoszenen

Es gibt keine integrierte KI Videogenerierung wie bei Veo oder Sora. Die kreative Flexibilität ist im Vergleich zu produktionsorientierteren Plattformen eingeschränkt.

Wenn du ausdrucksstarke Avatare und markenorientiertes Storytelling benötigst, ist dieses Tool nicht die beste Option.

Welche Stärken hat Elai?

- Extrem kurze Rendering-Zeiten

- Starke URL-zu-Video-Automatisierung

- PPTX-zu-Video-Abläufe

- Interaktive Schulungsmodule

- Option zur Erstellung eines Selfie-Avatars

- SCORM-fähiger Export

- Strukturierte, skalierbare Automatisierung

Besonders herausragend sind die Geschwindigkeit und Effizienz der Automatisierung.

Welche Schwächen hat Elai?

- Veraltete Benutzeroberfläche

- Schwache emotionale Ergebnisse

- Reduzierter Realismus durch die Haarkomposition

- Keine KI Videogenerierung

- Benutzeroptionen für die Übersetzung teilweise versteckt

- Falsche Credits-Abrechnung im kostenlosen Plan

Die Avatare funktionieren gut für strukturierte Inhalte, erscheinen jedoch nicht besonders lebendig.

Wie schneidet Elai im Vergleich zu HeyGen ab?

Die Stärke von Elai liegt in der Automatisierung, insbesondere in der schnellen Umwandlung von Dokumenten und Präsentationen in Videos. Im Gegensatz dazu erscheint HeyGen ausgeglichener und ausdrucksstärker, mit besseren Stimmen und natürlicheren Avatarbewegungen. Wenn du die schnellstmögliche Automatisierung von Text oder Folieninhalten suchst, ist Elai die richtige Wahl. Wenn du ansprechendere, ausdrucksstärkere Avatare brauchst, ist HeyGen natürlicher und persönlicher.

Was ist das Urteil über Elai?

Nach meinem Test halte ich Elai eher für ein praktisches Automatisierungstool als für eine kreative Avatar-Plattform.

Wenn du Dokumente, Präsentationen oder URLs schnell und im großen Maßstab in strukturierte Schulungsvideos umwandeln willst, ist Elai eine gute Wahl. Die Rendering-Geschwindigkeit ist hervorragend und die interaktiven Funktionen sind für LMS-gesteuerte Umgebungen nützlich.

Wenn du ausdrucksstarke Avatare, filmreifes Material oder emotional fesselndes Storytelling suchst, sind andere Plattformen wohl besser.

6. Colossyan

URL: https://www.colossyan.com/

Was ist Colossyan?

Als ich Colossyan im kostenlosen Plan testete, machte es von Anfang an einen aufgeräumten, strukturierten und für Unternehmen sehr geeigneten Eindruck.

Die Plattform ist kein kreatives Produktions-Ökosystem. Es handelt sich um eine folienorientierte KI-Videoplattform, die hauptsächlich für Schulungen, Einarbeitung, Compliance und Unternehmensdokumentation konzipiert ist. Der Ablauf ähnelt der PowerPoint-Logik mehr als einem dynamischen Videoeditor.

Colossyan legt den Fokus auf HR, L&D, Einarbeitung und Unternehmenssicherheit. Pluspunkte sind SOC 2, DSGVO-Compliance, SAML SSO und strukturierte Teamumgebungen. Die Positionierung ist klar: Zuverlässigkeit und Struktur zählen mehr als optischer Eindruck.

Der Erstellungsablauf folgt einem vorhersehbaren Muster: Skript, Szenen in einem folienorientierten Editor erstellen, Avatar und Stimme auswählen, generieren, bei Bedarf übersetzen, exportieren.

Es scheint für Schulungsteams in Unternehmen konzipiert zu sein, die Wert auf Konsistenz legen.

Wie realistisch sind die Avatare von Colossyan?

Ich testete die neueren NEO 2 Avatare, die als realistischer und präsenter auf dem Bildschirm vermarktet werden.

Es gibt merkliche Verbesserungen, aber der Realismus bleibt hinter anderen Plattformen zurück.

Die Lippensynchronisation ist genau. Das Gesamterscheinungsbild ist sauber und visuell angenehm. Allerdings können die Körperbewegungen steif wirken. In einem Fall sah eine Geste physisch unnatürlich aus. Ich habe versucht, sie selbst nachzuvollziehen und festgestellt, dass sie nicht der Bewegung eines echten Menschen entsprach.

Die emotionalen Übergänge stimmen nicht immer mit der Tonalität des Skripts überein. Im Vergleich zu ausdrucksstärkeren Systemen wirken die Avatare strukturiert und weniger natürlich.

Wie ausdrucksstark und natürlich wirken die Avatare?

Colossyan fehlt es vor allem an Ausdruckskraft.

Gesten wirken oft wie vorprogrammiert, nicht kontextbewusst. Die Bewegungsqualität hat sich mit NEO 2 verbessert, aber es fehlt weiterhin flüssiger Realismus.

Du kannst die Emotionen von Avataren anpassen, Gesten-Voreinstellungen anwenden, Darstellungsoptionen (Ganzkörperansicht, Bubble-Ansicht, Porträtansicht) wechseln und sogar Stimmen klonen. Es gibt Steuerungen, aber das Ergebnis erscheint nicht besonders ausdrucksstark.

Der Gesamteindruck ist didaktisch und stabil, nicht dynamisch.

Wie gut sind die Stimmen und die Lippensynchronisation?

Die Timing der Lippensynchronisation war in meinem Test präzise.

Allerdings erschien der Mundbereich manchmal leicht weich oder verschwommen. Die emotionale Abstimmung zwischen Stimme und Mimik war schwächer als bei fortschrittlicheren Systemen.

Die englische Sprachausgabe klang professionell, aber etwas roboterhaft. In Spanisch bemerkte ich kleine Audioartefakte und eine leicht robotische Textur der Ausgabe. Während des spanischen Renderings gab es auch kleine Inkonsistenzen mit Lippen und Fingern.

Sowohl die englische als auch die spanische Version fror während des Renderings vorübergehend bei 79 % ein, bevor sie abgeschlossen wurde. Sie wurden zwar abgeschlossen, doch die Verzögerung war spürbar.

Wie gut sind Lokalisierung und mehrsprachige Unterstützung?

Lokalisierung ist eine der Stärken von Colossyan.

Das Tool unterstützt über 100 Sprachen, KI Synchronisation und automatisierte Übersetzungen direkt im Editor. Der Übersetzungsablauf ist schnell und problemlos. Du musst die Plattform nicht verlassen und kein externes Tool verwenden.

In meinem spanischen Test wurde das Sprechtempo beibehalten, die Übersetzung war sofort innerhalb des Editors verfügbar. Die Lippensynchronisation blieb größtenteils genau, auch wenn der Realismus leicht abnahm und kleine Audio-Artefakte vorhanden waren.

Der Arbeitsablauf ist reibungsloser als bei einigen Mitbewerbern, aber die Realismus der Ausgabe ist geringer.

Für welche Anwendungsfälle ist Colossyan besonders gut geeignet?

Nach meinen Tests eignet sich Colossyan besonders gut für:

- Unternehmensschulungen

- HR-Onboarding

- Compliance-Module

- Dokument-zu-Video-Abläufe

- SCORM-fähige LMS-Integration

- Interaktive Verzweigungen und Quizfragen

Die Plattform unterstützt die Konvertierung von PPT und PDF in Video, Skript-zu-Video, KI Bildschirmaufnahmen, Versionierung, Analysen und LMS-fähigen SCORM-Export mit Fortschrittsspeicherung.

Wenn dein Ziel strukturierte Lerninhalte sind, macht das Sinn.

Bei welchen Anwendungsfällen hat Colossyan Probleme?

Colossyan ist weniger geeignet für:

- Marketingkampagnen

- Kreatives Storytelling

- Inhalte für soziale Medien

- KI-generierte filmische Visuals

- Dynamische, persönlichkeitsgeprägte Präsentationen

Es gibt keine erweiterten Generierungsmodelle für KI Videos wie bei Veo oder Sora. Die kreative Flexibilität ist im Vergleich zu stärker produktionsorientierten Ökosystemen begrenzt.

Welche Stärken hat Colossyan?

- Starke Strukturierung für Unternehmen

- Einfachheit

- Schnelle Übersetzung im Editor

- SCORM + LMS-Integration

- Interaktive Quizfragen und Verzweigungen

- 1080p-Export im kostenlosen Plan

- 4K-Export im kostenlosen Kontingent verfügbar

- Sicherheitsfunktionen für Unternehmen

Praktischer und fokussierter Funktionsumfang für Schulungsteams in Unternehmen

Welche Schwächen hat Colossyan?

- Weniger natürliche Gesten

- Geringerer emotionaler Realismus

- Kleinere Audioartefakte in der Übersetzung

- Gelegentliches Einfrieren beim Rendern

- Keine integrierten Generierungsmodelle für KI Video

- Begrenzte Musikbibliothek

Die Avatare funktionieren, wirken aber nicht besonders lebendig.

Wie schneidet Colossyan im Vergleich zu HeyGen ab?

Colossyan wirkt strukturierter und didaktischer als HeyGen. In meinen Tests wirkten die Avatare von HeyGen ausdrucksvoller und natürlicher, die Präsentation von Colossyan schien dagegen starrer und besser für folienorientierte Schulungen geeignet. Die Stärken von Colossyan liegen in der LMS-Integration, SCORM-Exports und Unternehmensschulungsabläufen. Wenn es um die Ausdruckskraft der Avatare und natürliche Bewegungen geht, hat HeyGen die Nase vorn.

Wie lautet das Urteil über Colossyan?

Nach den Tests halte ich Colossyan eher für eine strukturierte Unternehmenslösung und nicht für ein kreatives Produktionswerkzeug.

Wenn deine Prioritäten LMS-Integration, SCORM-Konformität, Dokument-zu-Video-abläufe und Unternehmensschulungsmodule sind, funktioniert Colossyan zuverlässig.

Wenn du ausdrucksstarke Avatare, stark emotionale Videos oder integrierte KI Videogenerierung für Marketinginhalte benötigst, sind andere Plattformen ausgereifter.

Das könnte dir auch gefallen

Was sind die besten Alternativen zu HeyGen zur Erstellung von KI Videos?

Synthesia wird allgemein als die führende Alternative zu HeyGen angesehen, dank der Kombination aus Avatar-Realismus, Funktionsumfang, Sprachunterstützung und der Tools für Unternehmen. Andere bemerkenswerte Plattformen sind Colossyan, Elai.io und D-ID, die jeweils ihre eigenen Stärken haben (z.B. Kosten, Avatar-Erstellung, Übersetzung oder Nischenanwendungen). Hour One wurde nach der Übernahme durch Wix eingestellt.

Diese Alternativen unterscheiden sich in Avatar-Vielfalt, Renderinggeschwindigkeit, Zusammenarbeit im Workspace und Exportoptionen – die „beste“ Wahl hängt stark vom spezifischen Videoanwendungsfall ab (Schulung, Marketing, interne Kommunikation usw.).

Wie schneidet Synthesia im Vergleich zu HeyGen bei Sprachunterstützung und Avatar-Auswahl ab?

Synthesia unterstützt über 140 Sprachen und Akzente und bietet mehr als 240 KI Avatare, was Kreativen eine viel breitere Palette zur Lokalisierung von Inhalten und zur Anpassung der Präsentationsstile gibt.

Im Gegensatz dazu deckt HeyGen nur ein begrenztes Sprachenset und weniger Avatar-Optionen ab. Das schränkt ein, wie effektiv du Inhalte lokalisieren oder die Markenstimme regionsübergreifend anpassen kannst. Die umfangreicheren Optionen in Synthesia reduzieren auch die Notwendigkeit, sich mit einem suboptimalen Avatar zufrieden zu geben, weil die gewünschten nicht unterstützt werden.

Welche KI Videoplattform bietet erweiterte Gesten- und Mimiksteuerung für Avatare?

Synthesia bietet in seinem Avatar-System nuancierte Gesten- und Mikro-Expressionskontrollen, sodass die digitalen Moderatoren lebensechter wirken und emotional besser abgestimmt sind.

In der Praxis bedeutet dies, dass deine Avatare nicht statisch oder roboterhaft aussehen – du kannst festlegen, wo sie gestikulieren, pausieren und die Mimik passend zur Tonalität animieren. Wenn Realismus und Engagement Priorität haben (insbesondere in Schulungen oder bei Mitteilungen, wo Vertrauen wichtig ist), bist du mit Synthesia klar im Vorteil.

Kann ich KI Videoplattformen ausprobieren, bevor ich mich für einen kostenpflichtigen Plan entscheide?

Die meisten KI Videogeneratoren bieten Testoptionen an, damit du die Funktionen ausprobieren kannst. Synthesia bietet einen kostenlosen Plan, mit dem du die Möglichkeiten der Plattform erkunden und Videos erstellen kannst. So kannst du sehen, wie unsere KI Avatare und die Stimmengenerierung für deine spezifischen Bedürfnisse funktionieren.

Welche HeyGen Alternative eignet sich am besten für Geschäftspräsentationen?

Für geschäftliche und unternehmensfokussierte Inhalte solltest du Plattformen wählen, die Branding, Übersetzung, Zusammenarbeit, Analytik und LMS-Integration unterstützen – und natürlich hochwertige Avatare anbieten.

Synthesia überzeugt hier aufgrund seines Brand Kits, des mehrsprachigen Video-Players, der Arbeitsbereiche für die Zusammenarbeit, des SCORM/LMS Exports und der integrierten Analytik. Diese Funktionen erleichtern es, Konsistenz zu bewahren, weltweit zu skalieren und den ROI zu messen. Viele einfacheren Alternativen bieten das im Unternehmensmaßstab nicht an.

Kann ich mit einer KI Videoplattform lokalisierte Videos erstellen?

Ja – Synthesia unterstützt 1-Klick-Übersetzung und KI Videosynchronisation, sodass du ein Ausgangsvideo in Dutzenden von Sprachen mit Lippensynchronisation und den gleichen Avataren produzieren kannst.

So kannst du ein Ausgangsvideo marktübergreifend verwenden, ohne dass Voiceovers neu aufzunehmen oder Szenen manuell neu zu animieren. Für globale Zielgruppen kann allein diese Funktion schon den Wechsel von einfacheren Plattformen rechtfertigen.

Auf welche Funktionen sollte ich bei einem Tool zur KI Videoerstellung achten?

Vergleiche die folgenden kritischen Funktionen:

- Avatar- und Sprachqualität (Realismus, Mikro-Expressionen, Lippen-Synchronisation)

- Sprach-/Lokalisierungsunterstützung (Sprachen, Akzente, Übersetzung)

- Interaktivität (klickbare CTAs, verzweigte Szenarien und Quizfragen in Videos)

- Tools für Zusammenarbeit & Teams (Rollenmanagement, Versionierung, Arbeitsbereiche)

- Integration und Exportmöglichkeiten (LMS/SCORM, API, Videoformate)

- Branding und Anpassung (Schriften, Farben, Logos, Custom Avatare)

- Analytik und Leistungsüberwachung

- Rendering-Geschwindigkeit und Ressourcenlimits

- Sicherheit, Compliance und Datenschutz